Müssen wir uns Sorgen über künstliche Intelligenz machen?

Im Detail: Der Aufstieg von KI-Robotern könnte die Zukunft der Menschheit bestimmen oder zerstören

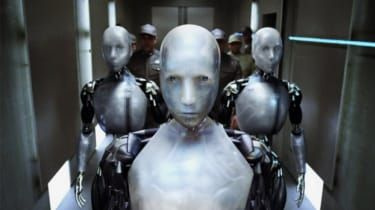

Intelligente Roboter übernehmen immer mehr Aufgaben

Getty Images

Der Erfolg bei der Schaffung einer effektiven KI könnte das größte Ereignis in der Geschichte unserer Zivilisation sein. Oder das Schlimmste. Wir wissen es einfach nicht, sagte Professor Stephen Hawking beim dieswöchigen Web Summit in Lissabon.

Neben vielen Vorteilen, sagte Hawking, bringt künstliche Intelligenz (KI) viele Gefahren mit sich, wie mächtige autonome Waffen oder neue Möglichkeiten für wenige, die vielen zu unterdrücken.

Der Physiker forderte eine neue Regulierung, um sicherzustellen, dass die Menschheit die KI daran hindern kann, ihre Existenz zu gefährden.

Vielleicht sollten wir alle einen Moment innehalten und uns nicht nur darauf konzentrieren, unsere KI besser und erfolgreicher zu machen, sondern auch auf das Wohl der Menschheit, fügte er hinzu.

Hawking ist nicht die einzige Koryphäe aus der Wissenschafts- und Technologiewelt, die vor der Zukunft der KI gewarnt hat.

Wir alle sollten sehr vorsichtig mit künstlicher Intelligenz sein, Bill Gates sagte Anfang dieses Jahres. Wenn ich raten müsste, was unsere größte existenzielle Bedrohung ist, dann ist es wahrscheinlich das. Mit künstlicher Intelligenz beschwören wir den Dämon.“

In den letzten Monaten gab es Schlagzeilen über Killer-Roboter und über Automatisierung, die menschliche Arbeiter ersetzt, aber auch über Algorithmen, die bei der Krebsdiagnose helfen, und die erfolgreiche Entwicklung selbstfahrender Autos.

Einige Wissenschaftler argumentieren, dass dies das dringendste existenzielle Risiko ist, dem die Menschheit jemals ausgesetzt sein könnte, während andere die hypothetische Gefahr meist als unbegründete Untergangstreiberei abtun, sagt Hauptplatine von Phil Torres.

Sollten wir uns also Sorgen über die Verbreitung von KI machen? Und was können wir dagegen tun?

Die Reaktion auf AI

ZU YouGov Eine Umfrage unter mehr als 2.000 Personen im letzten Jahr ergab, dass die öffentliche Einstellung zu KI je nach Anwendung stark variiert.

Etwa 70 % der Befragten freuen sich, wenn intelligente Maschinen scheinbar untergeordnete Aufgaben wie die Pflanzenüberwachung übernehmen – bei Haushaltsaufgaben sind es 49 %, während sich nur 23 % über Roboter freuen, die medizinische Eingriffe durchführen. Und nur 17 % waren mit der Idee von sogenannten Sexrobotern zufrieden.

Eine der Hauptsorgen bei der KI ist ihre unpersönliche Natur.

Im August haben Elon Musk, CEO von Tesla und SpaceX, zusammen mit 115 anderen KI- und Robotik-Spezialisten, einen offenen Brief unterschrieben fordert die UNO auf, die Gefahren tödlicher autonomer Waffen anzuerkennen und ihren Einsatz international zu verbieten.

Laut der Menschenrechtsbeobachtung -Organisation haben die USA, China, Israel, Südkorea, Russland und das Vereinigte Königreich in die Entwicklung von Waffensystemen mit abnehmender menschlicher Kontrolle in den kritischen Funktionen der Auswahl und Bekämpfung von Zielen investiert.

Steven Finlay , Autor von Artificial Intelligence and Machine Learning for Business, glaubt, dass autonome bewaffnete Roboter, die Menschen mithilfe von Gesichtserkennungssoftware aufspüren und anvisieren können, unmittelbar bevorstehen.

KI und Robotik schreiten so schnell voran, dass innerhalb von Jahren Kriege mit autonomen Waffen und Fahrzeugen geführt werden könnten, berichtet Der Wächter .

Regulieren oder ausrotten?

KI-Regulierung ist eine Antwort auf das Problem.

Eine gesunde moderne Demokratie erfordert, dass sich normale Bürger an öffentlichen Diskussionen über sich schnell entwickelnde Technologien beteiligen. Wir brauchen dringend neue Richtlinien, Vorschriften und Sicherheitsnetze für diejenigen, die von Maschinen vertrieben wurden, sagt Die Nation 's Katharine Dempsey.

Elon Musk stimmt zu. Bereits 2014 sagte er: Ich neige immer mehr dazu, zu denken, dass es eine gewisse Regulierungsaufsicht geben sollte, vielleicht auf nationaler und internationaler Ebene, nur um sicherzustellen, dass wir nichts sehr Dummes tun.

Die größte Sorge besteht wohl darin, dass Maschinen bessere Entscheidungen treffen als Menschen und die Menschheit automatisierten Entscheidungsträgern und demjenigen, der sie kontrolliert, versklaven.

KI-basierte Systeme ersetzen bereits viele Jobs. Einige KI-Maschinen können beispielsweise Hautkrebs so genau erkennen wie ein menschlicher Arzt. Verdrahtet berichtet.

Viele unserer Entscheidungen werden bereits durch KI beeinflusst, über Websites wie Amazon und Facebook. Algorithmen bestimmen die Inhalte, die wir online sehen, und geben Empfehlungen zu allem, was wir im Fernsehen sehen und wo wir essen, bis hin zu unseren Dates.

Was dieses Szenario so gefährlich macht, ist, dass es nicht von einem übergreifenden Master Intelligence oder Machine Overlord geplant wird, sagt Steven Finlay. Wir schaffen genau die Technologie, die zu unserem Untergang führen könnte.

Eine Wende zum Besseren?

Es ist nicht alles Untergang und Finsternis.

Ich bin optimistisch, dass wir mit KI eine inspirierende Zukunft schaffen können, wenn wir das Rennen zwischen der wachsenden Leistungsfähigkeit der KI und der wachsenden Weisheit, mit der wir sie verwalten, gewinnen, aber das erfordert Planung und Arbeit, Physiker Max Tegmark, Autor von Life 3.0: Mensch sein im Zeitalter der Künstlichen Intelligenz, erzählt Hauptplatine .

Tegmark befürwortet zwar eine Regulierung, argumentiert jedoch, dass der Einsatz von KI auch nach oben gerichtet sein muss. Wenn sich die Leute nur auf die Schattenseiten konzentrieren, werden sie von Angst gelähmt und die Gesellschaft polarisiert und zerbricht, schlussfolgert er.